1. Introdução

A proteção de dados tornou-se uma das principais preocupações para empresas de todos os setores. Com o avanço da digitalização e o crescimento exponencial da coleta de informações pessoais, garantir a segurança e a privacidade dos dados passou a ser uma obrigação legal e um diferencial competitivo. No Brasil, a Lei Geral de Proteção de Dados (LGPD) trouxe diretrizes claras para o tratamento adequado de informações pessoais, estabelecendo responsabilidades para empresas e organizações que manipulam esses dados.

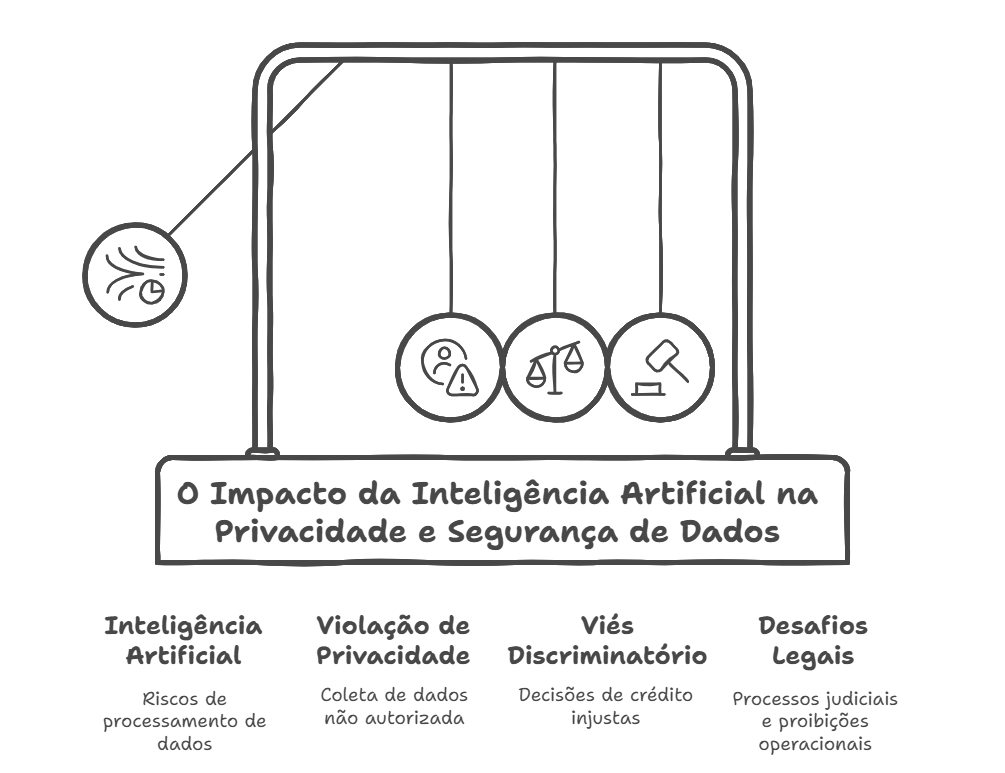

A Inteligência Artificial (IA), embora ofereça inúmeras vantagens para a automação de processos e análise de grandes volumes de dados, introduziu riscos sem precedentes à privacidade e à segurança da informação. Ferramentas baseadas em IA podem armazenar e processar informações pessoais sem um controle adequado, tornando-se alvos fáceis para ataques cibernéticos e incidentes de vazamento de dados. Além disso, a IA pode ser treinada de forma enviesada, tomando decisões discriminatórias e expondo empresas a riscos regulatórios e reputacionais.

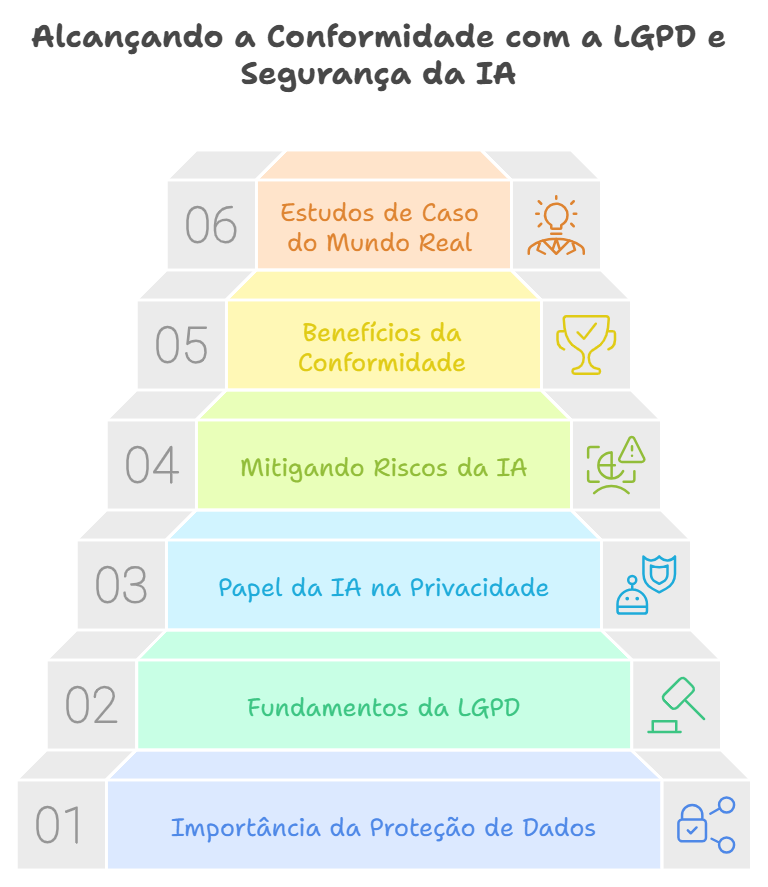

Este guia abordará de forma completa e didática os principais aspectos da proteção de dados no contexto da LGPD e compliance, destacando o impacto da inteligência artificial na segurança da informação. Ao longo do conteúdo, serão explorados:

- A importância da proteção de dados e os riscos associados à negligência nesse tema;

- Os fundamentos da LGPD e a necessidade de compliance para evitar sanções;

- O papel da inteligência artificial na privacidade e segurança de dados, incluindo suas vulnerabilidades;

- Estratégias para mitigar riscos e garantir um uso ético da IA;

- Os benefícios empresariais da conformidade com regulamentações;

- Casos reais de empresas que enfrentaram desafios e implementaram boas práticas.

2. O que é Proteção de Dados e sua Importância para Empresas?

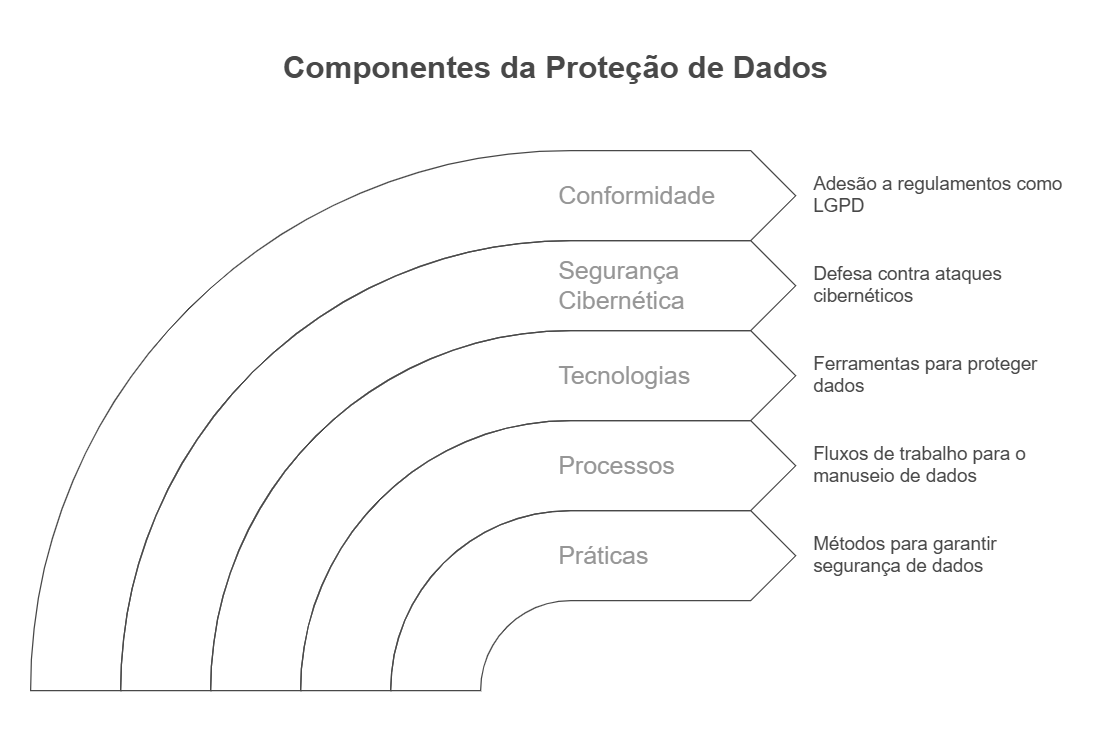

A proteção de dados refere-se ao conjunto de práticas, processos e tecnologias adotadas para garantir que informações pessoais sejam coletadas, armazenadas e processadas de forma segura e ética. O principal objetivo dessa disciplina é evitar acessos não autorizados, vazamentos, roubo de dados e usos indevidos das informações.

Com o aumento dos ataques cibernéticos e dos escândalos de vazamento de dados, garantir a proteção de informações deixou de ser apenas uma preocupação técnica e passou a ser um imperativo estratégico para empresas que desejam manter a confiança dos clientes e evitar penalidades severas.

Um exemplo emblemático da importância da proteção de dados foi o caso do Facebook-Cambridge Analytica, onde a empresa britânica Cambridge Analytica teve acesso indevido a dados de 87 milhões de usuários do Facebook. As informações foram utilizadas sem consentimento para influenciar campanhas políticas, incluindo as eleições presidenciais dos EUA em 2016. Esse escândalo gerou um impacto global e resultou em investigações regulatórias e multas milionárias para o Facebook.

Outro caso marcante no Brasil foi o vazamento de dados da Serasa Experian, onde informações de 220 milhões de brasileiros foram expostas em fóruns da dark web. Esse incidente gerou um alerta para empresas sobre a necessidade de investir em segurança da informação e conformidade com a LGPD.

Diante de situações como essas, empresas de qualquer porte e setor precisam adotar práticas eficazes de proteção de dados, garantindo que as informações pessoais de clientes, fornecedores e colaboradores sejam manipuladas com segurança, transparência e responsabilidade.

3. Fundamentos da LGPD e Compliance

A Lei Geral de Proteção de Dados (LGPD), sancionada em 2018 e em vigor desde 2020, estabelece diretrizes rigorosas para a coleta, armazenamento, tratamento e compartilhamento de dados pessoais no Brasil. Inspirada no Regulamento Geral de Proteção de Dados (GDPR) da União Europeia, a LGPD busca garantir a privacidade dos titulares e responsabilizar empresas que lidam com informações pessoais de forma inadequada.

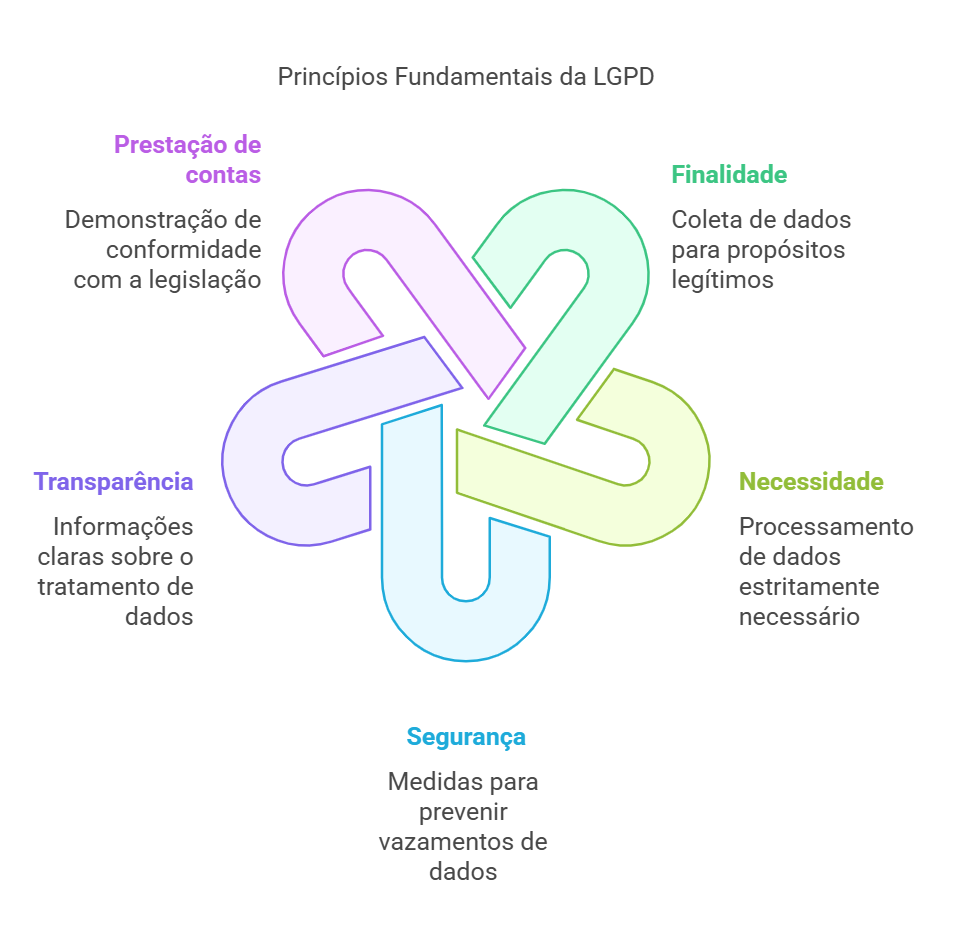

Entre os principais princípios da LGPD, destacam-se:

- Finalidade: Os dados devem ser coletados e tratados para propósitos específicos, legítimos e informados ao titular.

- Necessidade: Apenas os dados estritamente necessários devem ser processados.

- Segurança: Medidas técnicas e administrativas devem ser adotadas para evitar acessos indevidos e vazamentos.

- Transparência: As empresas devem fornecer informações claras e acessíveis sobre o tratamento de dados.

- Prestação de contas: As organizações precisam demonstrar conformidade com a legislação e garantir que as medidas de proteção de dados sejam efetivas.

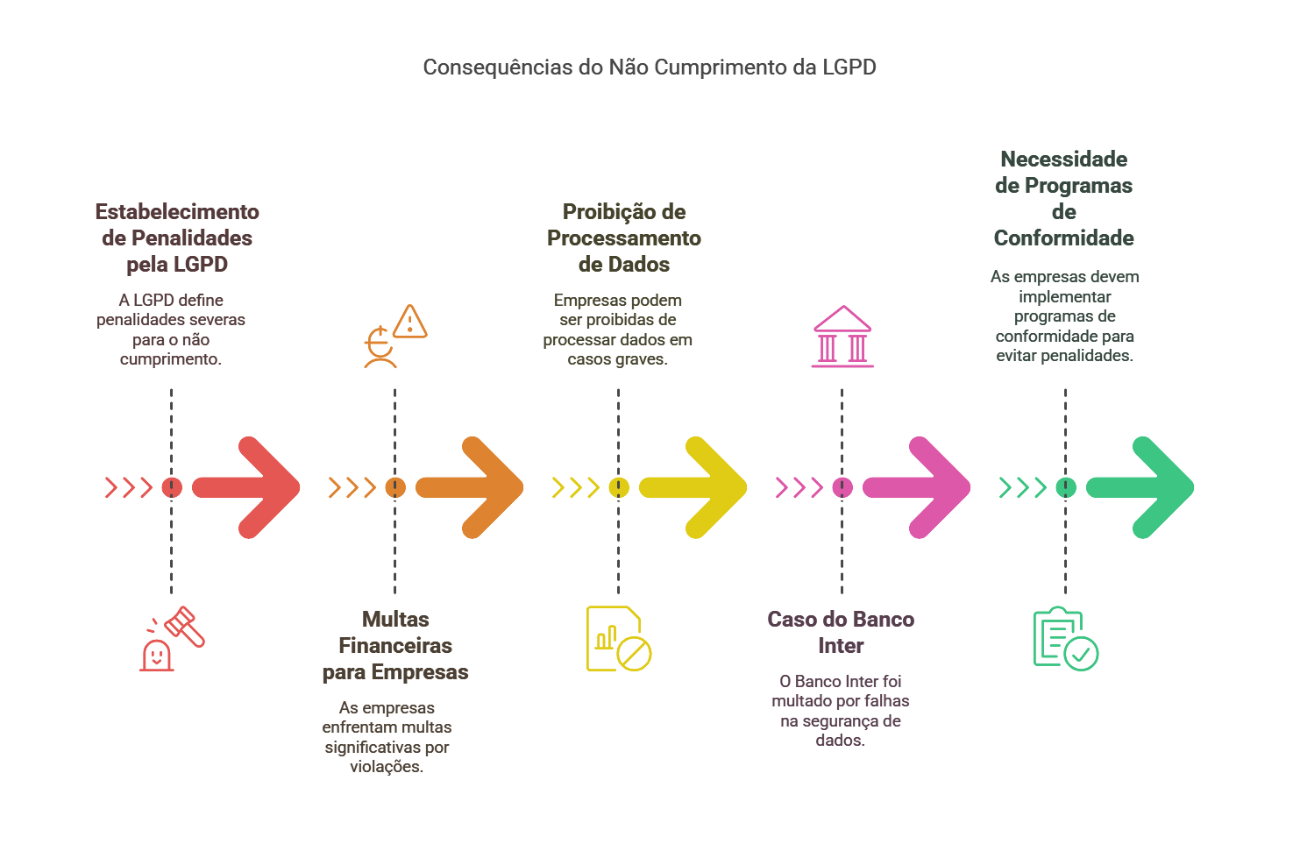

A LGPD estabelece sanções severas para o descumprimento das normas, incluindo multas de até 2% do faturamento da empresa, limitadas a R$ 50 milhões por infração. Além disso, as empresas podem ser proibidas de tratar dados pessoais em casos graves de descumprimento.

Em 2022, o Banco Inter foi multado por falhas na segurança de dados que resultaram no vazamento de informações bancárias de 19 mil clientes. A falta de mecanismos robustos de proteção expôs os dados sensíveis e colocou a empresa em uma posição vulnerável diante da fiscalização da Autoridade Nacional de Proteção de Dados (ANPD).

Para evitar penalidades e manter a confiança do público, as empresas devem adotar um Programa de Compliance Digital, que inclua:

- Nomeação de um DPO (Encarregado de Proteção de Dados);

- Implementação de políticas internas de segurança da informação;

- Treinamento contínuo de colaboradores sobre privacidade de dados;

- Criação de mecanismos para atendimento dos direitos dos titulares;

- Monitoramento contínuo da conformidade com a LGPD.

4. O Impacto da Inteligência Artificial na Privacidade e Segurança de Dados

A Inteligência Artificial (IA) tem sido cada vez mais utilizada para analisar grandes volumes de dados, melhorar a personalização de serviços e automatizar processos. No entanto, a forma como esses sistemas são treinados e aplicados pode representar riscos significativos para a privacidade e segurança da informação.

Um dos maiores desafios da IA está na quantidade de dados pessoais que essas tecnologias processam. Algoritmos de Machine Learning são treinados com grandes bases de informações, muitas vezes sem que haja controle sobre a origem desses dados ou o consentimento do titular.

Casos como o do Clearview AI, uma empresa de reconhecimento facial que coletou milhões de imagens sem autorização para treinar seu sistema de identificação, mostram como a IA pode ser usada de maneira abusiva e sem transparência. A Clearview enfrentou processos judiciais em diversos países, sendo proibida de operar em alguns locais devido às práticas invasivas de coleta de dados.

Outro exemplo problemático envolve o uso de IA para análise preditiva em sistemas bancários e de crédito. Alguns algoritmos desenvolveram viés discriminatório, negando crédito a grupos minoritários com base em padrões históricos injustos, reforçando desigualdades e expondo empresas a riscos regulatórios.

Diante desses desafios, empresas que utilizam IA devem implementar salvaguardas robustas para garantir a conformidade com as leis de proteção de dados. Isso inclui:

- Minimização da coleta de dados, utilizando apenas as informações essenciais;

- Treinamento de IA com bases de dados balanceadas, reduzindo vieses discriminatórios;

- Revisão e auditoria constante dos algoritmos para garantir decisões justas;

- Anonimização de informações pessoais para evitar a exposição indevida.

Ao combinar boas práticas de proteção de dados, compliance e governança da IA, empresas podem aproveitar os benefícios da tecnologia sem comprometer a privacidade e a segurança das informações.

Nos próximos tópicos, aprofundaremos as vulnerabilidades da IA e estratégias para mitigação de riscos.

5. Principais Vulnerabilidades da IA e Como Mitigá-las

A implementação da Inteligência Artificial (IA) em processos empresariais trouxe benefícios significativos, como a automação de tarefas e a análise preditiva de grandes volumes de dados. No entanto, essas mesmas capacidades aumentam os riscos de segurança e privacidade, exigindo medidas rigorosas para mitigar ameaças e garantir a conformidade com a LGPD e outras regulamentações globais.

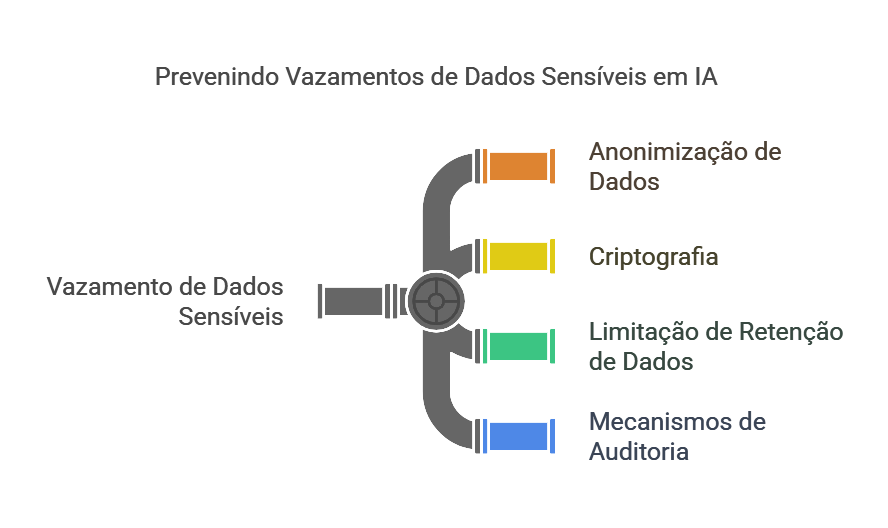

5.1. Vazamento de Dados Sensíveis por Modelos de IA

Os sistemas de IA precisam ser treinados com grandes quantidades de dados, que muitas vezes incluem informações pessoais identificáveis (PII). Em casos onde a anonimização não foi feita corretamente, dados sensíveis podem ser acessados, extraídos e utilizados de maneira indevida.

Um caso emblemático ocorreu com a OpenAI, quando pesquisadores demonstraram que modelos de IA treinados em grandes conjuntos de dados poderiam ser explorados para recuperar informações pessoais que não deveriam estar acessíveis. Isso significa que um chatbot pode, inadvertidamente, fornecer dados sigilosos de usuários sem que haja um controle adequado.

Como mitigar?

- Implementar anonimização e criptografia antes de inserir os dados nos modelos.

- Limitar a retenção de dados utilizados para o treinamento de IA.

- Criar mecanismos de auditoria para verificar se o modelo está vazando informações indevidas.

5.2. Viés Algorítmico e Decisões Discriminatórias

Os modelos de IA aprendem padrões a partir dos dados de treinamento. Se esses dados contêm discriminação histórica ou vieses sociais, a IA pode perpetuar e até ampliar essas desigualdades, tomando decisões injustas.

Um exemplo conhecido é o sistema de recrutamento da Amazon, que foi descontinuado após descobertas de que seu algoritmo tendia a desfavorecer currículos de mulheres para cargos técnicos. O modelo foi treinado com um histórico de contratações predominantemente masculinas, e, por isso, aprendeu a dar prioridade a perfis semelhantes.

Como mitigar?

- Diversificar os dados de treinamento, garantindo que o conjunto de dados seja equilibrado e representativo.

- Aplicar auditorias frequentes nos modelos para detectar e corrigir vieses.

- Adotar modelos explicáveis (Explainable AI – XAI), permitindo que as decisões possam ser justificadas e revisadas por humanos.

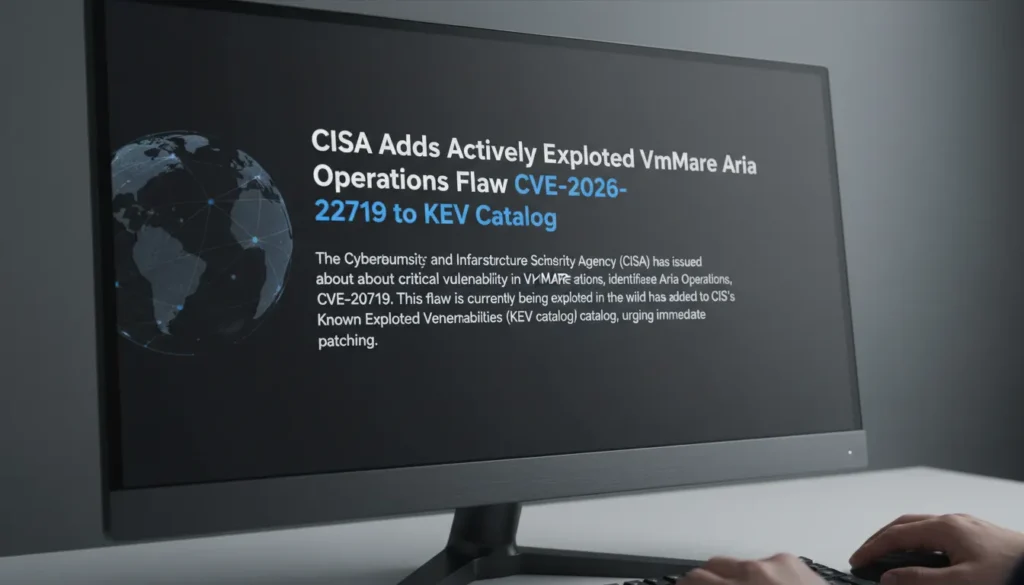

5.3. Ataques Adversariais: Manipulação de Modelos de IA

Os ataques adversariais ocorrem quando hackers manipulam entradas de dados para enganar um modelo de IA e forçá-lo a tomar decisões incorretas. Esse tipo de ataque pode ser explorado para fraudar sistemas de segurança, reconhecimento facial e detecção de ameaças.

Um estudo conduzido pelo MIT mostrou que pequenas alterações em imagens podem enganar sistemas de IA, fazendo, por exemplo, com que um modelo de reconhecimento de imagens classifique um panda como um guaxinim. Esse tipo de falha pode ter graves implicações na segurança cibernética e na proteção de dados.

Como mitigar?

- Implementar técnicas de robustez nos modelos de IA para resistir a ataques adversariais.

- Monitorar continuamente atividades suspeitas nos sistemas baseados em IA.

- Utilizar testes de penetração em modelos de IA para identificar vulnerabilidades antes que sejam exploradas.

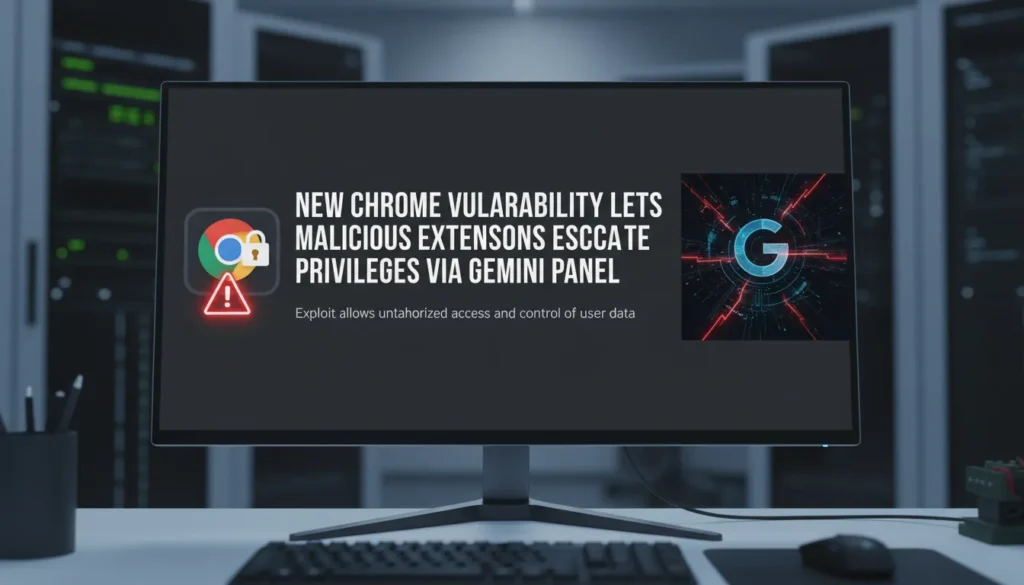

5.4. Uso Indevido de Dados e Falta de Consentimento

Muitas empresas utilizam dados coletados sem transparência para treinar modelos de IA sem o devido consentimento dos usuários. Esse problema ficou evidente no caso da Clearview AI, uma empresa que coletou milhões de imagens da internet para treinar seu sistema de reconhecimento facial sem autorização dos indivíduos retratados. O escândalo resultou em proibições legais e ações judiciais na União Europeia, Canadá e Austrália.

Como mitigar?

- Garantir que a coleta de dados seja feita com o consentimento explícito dos usuários.

- Adotar mecanismos de exclusão de dados caso um titular solicite sua remoção (conforme prevê a LGPD).

- Transparência total sobre como os dados estão sendo utilizados e para quais propósitos.

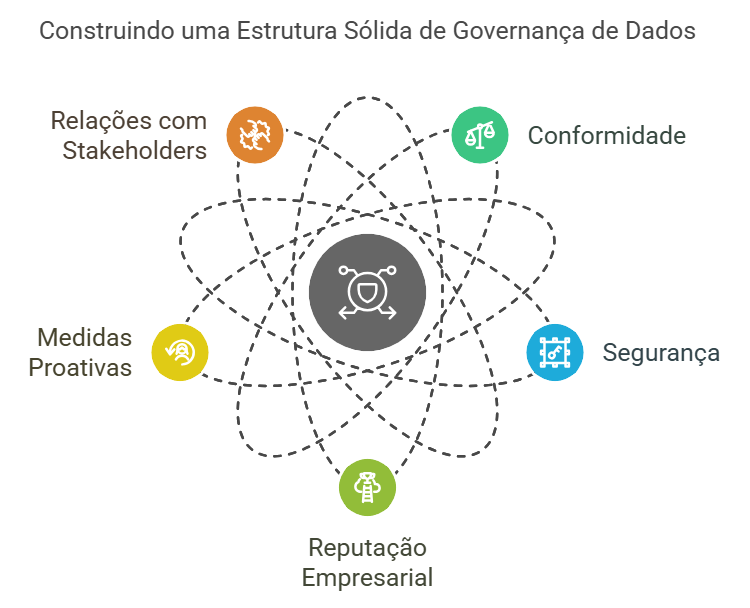

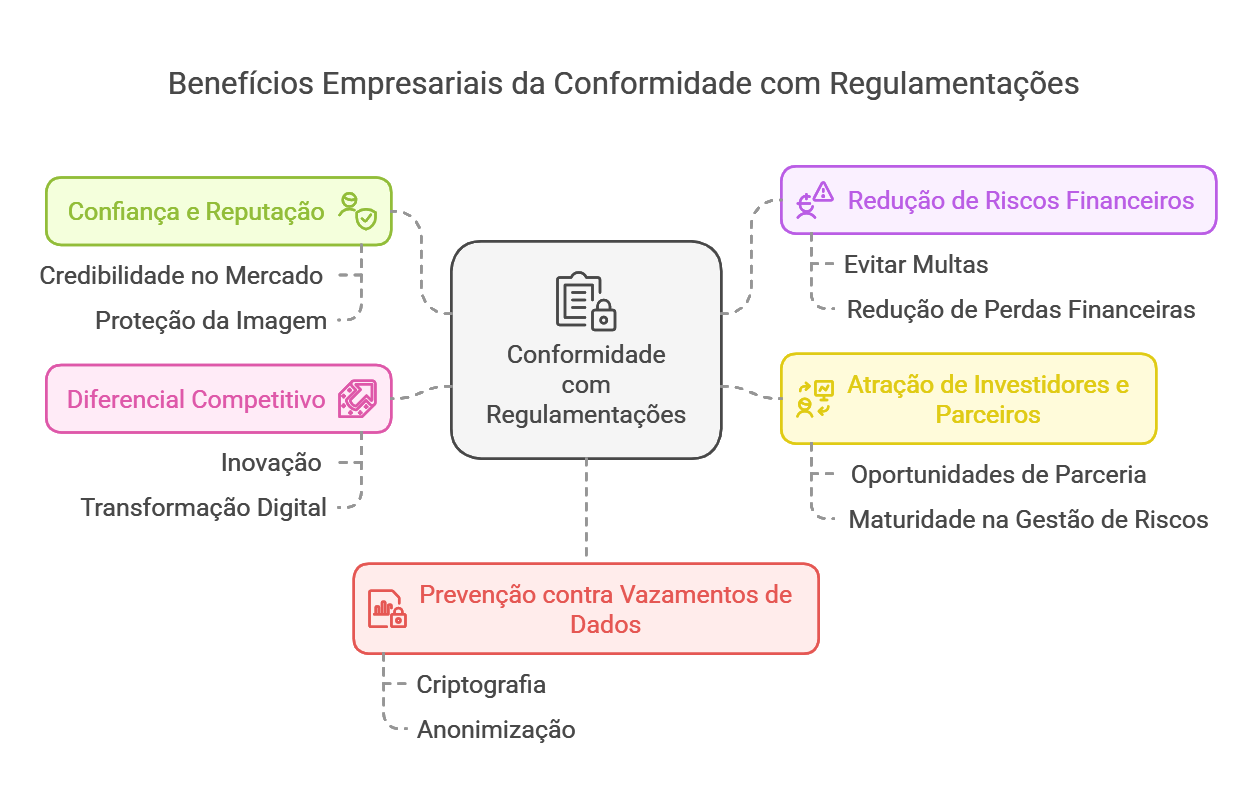

6. Benefícios Empresariais da Conformidade com Regulamentações

Muitas empresas ainda enxergam a LGPD e outras regulamentações de proteção de dados como um obstáculo. No entanto, organizações que adotam práticas sólidas de segurança e compliance colhem benefícios estratégicos que vão além da simples conformidade legal.

Entre os principais benefícios da adequação à LGPD e proteção de dados empresariais, destacam-se:

✅ Confiança e reputação: Empresas que demonstram compromisso com a privacidade dos clientes ganham credibilidade no mercado, reduzindo riscos de crise de imagem.

✅ Redução de riscos financeiros: A conformidade evita multas e sanções, que podem ser extremamente severas, como o caso do Facebook, que foi multado em US$ 5 bilhões pela FTC devido a violações de privacidade.

✅ Atração de investidores e parceiros estratégicos: Empresas que estão em conformidade se tornam mais atrativas para parcerias e fusões, pois demonstram maturidade na gestão de riscos cibernéticos.

✅ Diferencial competitivo: Organizações que integram segurança e privacidade como valores essenciais criam um ambiente mais seguro para inovação e transformação digital.

✅ Prevenção contra vazamentos de dados: A adoção de práticas como criptografia, anonimização e governança de dados reduz significativamente a exposição a ataques cibernéticos.

🔎 Leitura complementar: Como a conformidade com a LGPD pode gerar mais negócios.

7. Exemplos Práticos de Aplicação

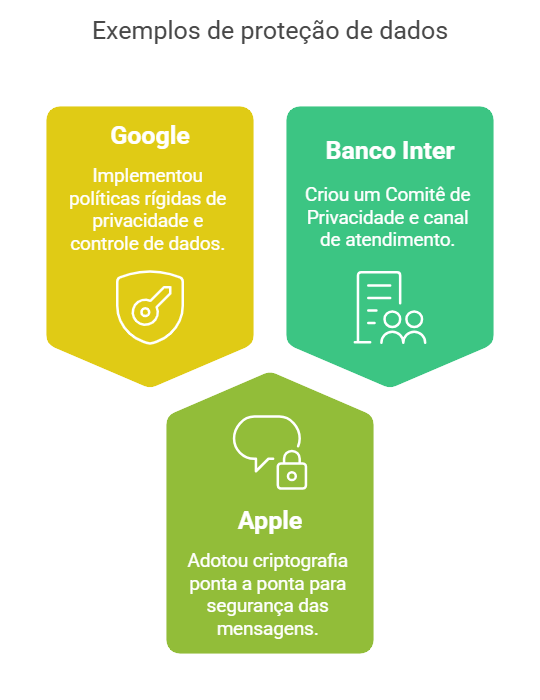

A implementação eficaz da proteção de dados e do compliance já se mostrou essencial para diversas empresas. Veja alguns exemplos reais de organizações que enfrentaram desafios e adotaram boas práticas para garantir a segurança da informação.

📌 Google: Após enfrentar diversas investigações sobre privacidade, a empresa implementou políticas mais rígidas, permitindo que usuários controlem a coleta e o armazenamento de seus dados. Além disso, desenvolveu tecnologias de aprendizado federado, que treinam modelos de IA sem a necessidade de centralizar os dados dos usuários.

📌 Apple: Adotou criptografia ponta a ponta em dispositivos e serviços como o iMessage e o FaceTime, garantindo que nem a própria empresa tenha acesso ao conteúdo das mensagens dos usuários.

📌 Banco Inter: Após um incidente de vazamento de dados, criou um Comitê de Privacidade para reforçar a governança de dados e implementou um canal de atendimento aos titulares para garantir transparência sobre o tratamento de informações pessoais.

8. Conclusão

A proteção de dados e a governança da IA são essenciais para garantir conformidade, segurança e reputação empresarial. Empresas que adotam práticas sólidas de compliance e segurança da informação não apenas evitam multas e sanções, mas também fortalecem sua posição no mercado.

Diante da crescente integração da Inteligência Artificial em serviços e produtos, as empresas devem adotar medidas proativas para garantir que suas soluções sejam seguras, justas e transparentes.

A conformidade com a LGPD e outros regulamentos de proteção de dados não é apenas um requisito legal, mas uma oportunidade para criar relações mais sólidas com clientes, parceiros e investidores.

Se sua empresa deseja implementar um programa robusto de conformidade e segurança da informação, entre em contato com nossos especialistas para garantir que sua organização esteja protegida contra riscos de privacidade e cibersegurança.

🔎 Leitura complementar: Checklist: Como implementar um programa de conformidade digital.