Introdução

A Inteligência Artificial (IA) revolucionou a forma como empresas e governos lidam com informações, otimizando processos e tornando a análise de grandes volumes de dados mais eficiente. No entanto, essa evolução tecnológica trouxe desafios significativos para a privacidade e a proteção de dados.

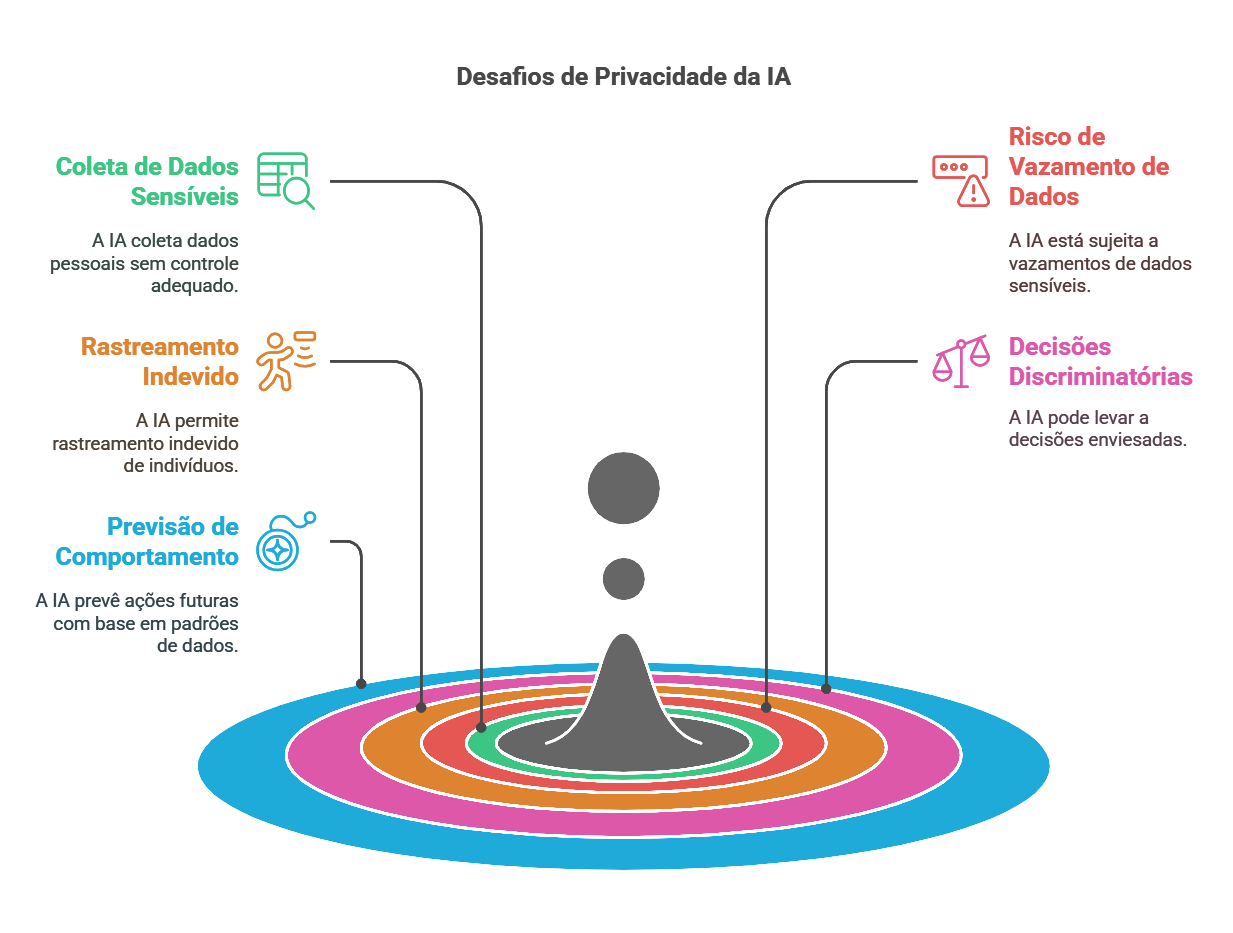

Sistemas de IA podem coletar, processar e armazenar informações sensíveis sem o devido controle, expondo usuários a vazamentos, rastreamento indevido e decisões discriminatórias. Além disso, a IA pode aprender padrões de comportamento e prever ações futuras, o que levanta preocupações sobre segurança, consentimento e uso ético dos dados.

Neste artigo, vamos explorar:

- Como a IA coleta e processa dados pessoais

- Os principais riscos da IA para a privacidade

- Casos reais de vazamento de dados e decisões enviesadas

- Estratégias para proteger informações e mitigar riscos

Se você deseja saber como proteger seus dados e garantir conformidade com a LGPD, continue lendo e descubra as melhores práticas para segurança e governança da IA.

1. Como a Inteligência Artificial Coleta e Processa Dados Pessoais?

A Inteligência Artificial depende de dados para funcionar de maneira eficaz. Algoritmos de Machine Learning (ML) e Deep Learning aprendem a partir da análise de grandes volumes de informações, extraindo padrões e gerando previsões. Isso significa que quanto mais dados forem coletados, mais preciso será o modelo de IA.

1.1. Fontes de Coleta de Dados para IA

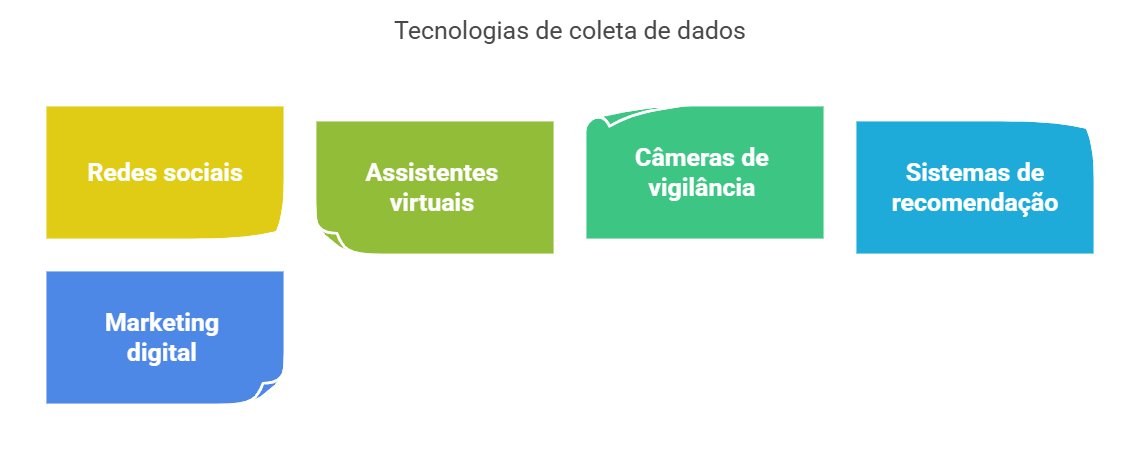

Os sistemas de IA podem obter dados de diversas fontes, incluindo:

- Redes sociais e aplicativos: Perfis de usuários, interações e mensagens privadas podem ser analisados.

- Assistentes virtuais (Alexa, Siri, Google Assistant): Comandos de voz podem ser armazenados e analisados para melhorar o serviço.

- Câmeras de vigilância e reconhecimento facial: Tecnologias que utilizam IA para identificar rostos em tempo real.

- Sistemas de recomendação: Plataformas como Netflix e Spotify coletam preferências para sugerir conteúdos personalizados.

- Ferramentas de anúncios e marketing digital: IA analisa padrões de comportamento para segmentar anúncios.

Embora a coleta de dados seja necessária para o aprendizado da IA, o problema surge quando essas informações são armazenadas sem consentimento ou usadas para fins não autorizados.

🔎 Leitura complementar: LGPD e Compliance: Como garantir a proteção de dados em sua empresa.

2. Principais Riscos da Inteligência Artificial para a Privacidade

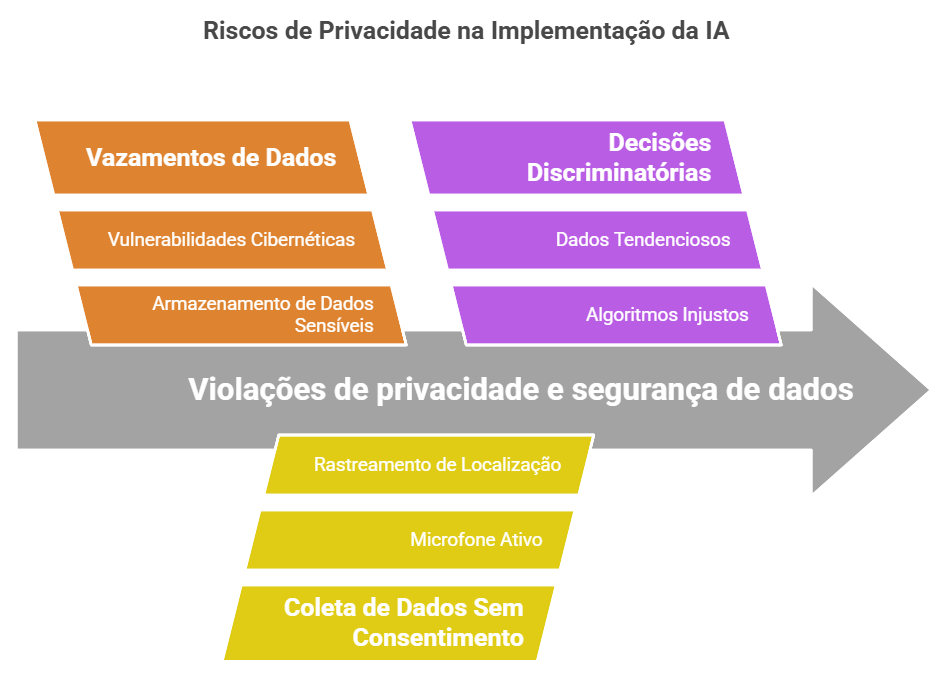

O uso da IA em diversos setores tem gerado preocupações crescentes sobre a privacidade e a segurança de dados. Alguns dos riscos mais críticos incluem:

2.1. Vazamento de Dados Sensíveis

Sistemas de IA armazenam grandes quantidades de informações pessoais, tornando-se alvos de ataques cibernéticos. Caso não haja medidas adequadas de proteção, essas informações podem vazar e ser utilizadas indevidamente.

Caso real:

Em 2022, um vazamento de dados do ChatGPT expôs informações de usuários, incluindo conversas privadas e dados de pagamento. O incidente levantou questionamentos sobre a segurança de modelos de IA baseados em nuvem.

2.2. Coleta de Dados Sem Consentimento

Muitos aplicativos e plataformas coletam dados pessoais sem informar claramente os usuários. Isso pode incluir microfone sempre ativo, rastreamento de localização e leitura de mensagens privadas.

Caso real:

O Facebook foi multado em US$ 5 bilhões pela FTC (Federal Trade Commission) após um escândalo que revelou que a plataforma coletava dados de usuários sem permissão para treinar seus algoritmos de IA.

🔎 Leitura complementar: Como evitar o uso indevido de dados sensíveis por modelos de IA.

2.3. Decisões Algorítmicas Discriminatórias

Sistemas de IA podem ser treinados em dados enviesados, resultando em decisões injustas e discriminatórias. Isso já aconteceu em setores como bancos, contratações e segurança pública.

Caso real:

O algoritmo de recrutamento da Amazon foi descontinuado após favorecer homens em detrimento de mulheres em processos seletivos. Como o modelo foi treinado com dados históricos, ele reforçou padrões machistas, prejudicando a equidade nas contratações.

🔎 Leitura complementar: Viés algorítmico: Como evitar decisões discriminatórias com IA.

3. Como Proteger seus Dados e Mitigar Riscos da IA?

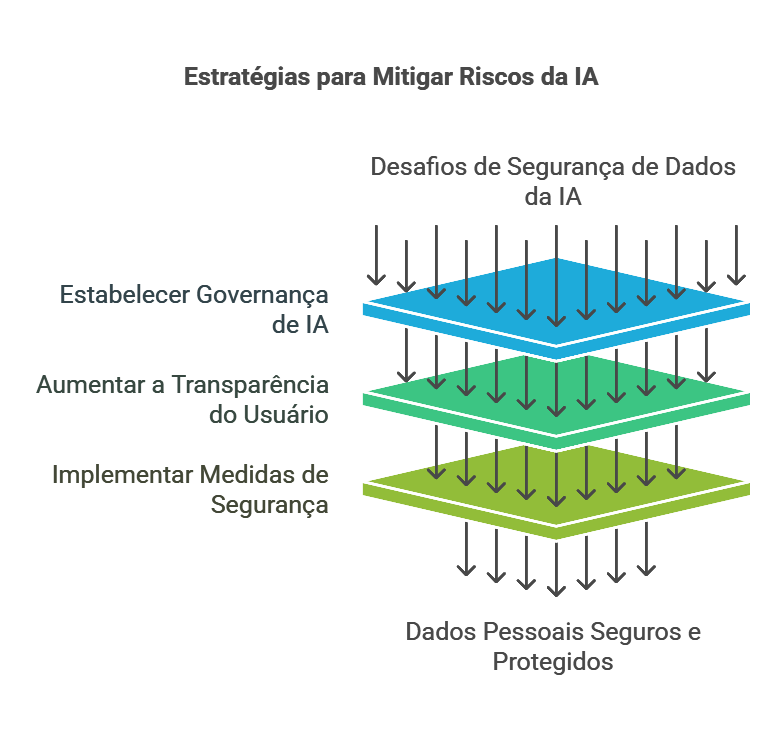

Apesar dos desafios, existem estratégias que podem ser adotadas para minimizar os riscos da IA e garantir a proteção dos dados pessoais.

3.1. Implementação de Governança de IA

As empresas devem estabelecer políticas de governança de dados para garantir que a IA seja usada de forma ética e segura. Isso inclui:

- Criar comitês de auditoria para monitorar o uso da IA.

- Garantir que os dados coletados possuem consentimento explícito do titular.

- Aplicar anonimização para evitar identificação de indivíduos.

3.2. Maior Transparência e Controle para os Usuários

Os usuários devem ter acesso às suas informações pessoais e poder decidir como seus dados serão utilizados. Isso pode ser feito por meio de:

- Políticas de privacidade claras e acessíveis.

- Opção de remover ou modificar informações pessoais dentro dos serviços.

- Controle granular sobre permissões de acesso a microfone, localização e câmeras.

🔎 Leitura complementar: Direitos dos titulares na LGPD: Como proteger suas informações.

3.3. Proteção Contra Vazamentos e Ataques Cibernéticos

Medidas de segurança devem ser aplicadas para evitar ataques adversariais e vazamentos de dados, incluindo:

- Uso de criptografia de ponta a ponta para proteger informações.

- Implementação de testes de penetração em modelos de IA.

- Monitoramento contínuo de atividades suspeitas em sistemas de IA.

🔎 Leitura complementar: Como tornar sistemas de IA mais seguros e éticos.

Conclusão

A Inteligência Artificial já faz parte do nosso cotidiano, mas o seu impacto na privacidade precisa ser controlado. Sem regulamentações adequadas e medidas de segurança eficazes, dados sensíveis podem ser utilizados indevidamente, expondo empresas e usuários a riscos jurídicos e financeiros.

Se sua empresa utiliza IA para análise de dados ou automação de processos, garanta que suas soluções estejam em conformidade com a LGPD e as melhores práticas de segurança. Investir em transparência, governança e proteção de dados não é apenas uma obrigação legal, mas também uma estratégia para fortalecer a reputação e a confiança do público.

🔎 Leitura complementar: Checklist de conformidade com a LGPD para empresas que utilizam IA.

Quer saber mais sobre como proteger seus dados? Entre em contato com nossos especialistas e descubra como sua empresa pode implementar IA de forma segura e ética! 🚀